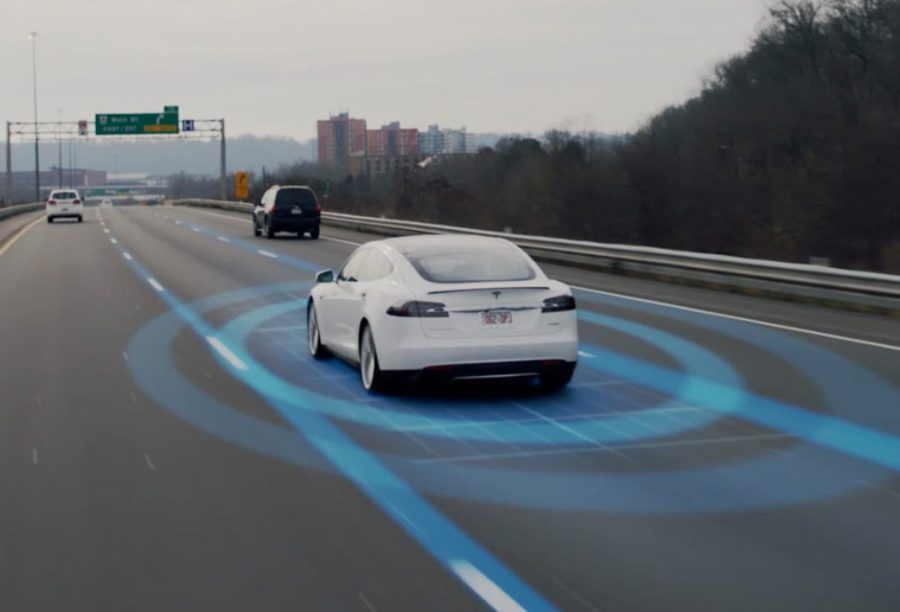

Tesla prednedávnom upustila od využívania radarov na snímanie hĺbky priestoru a pre svoje autonómne riadenie sa rozhodla využívať výhradne kamery a komplexnú neurónovú sieť. Hacker teraz ukázal, ako reálne Tesla vidí vozovku a svoje okolie v praxi.

Elektromobily Tesla si musia v rámci fungovania asistenčných systémov a autonómneho riadenia po novom namiesto radarov vystačiť výhradne so zostavou ôsmych kamier a neurónovou sieťou, ktorá na lokálnom hardvéri vypočítava priestorovú mapu svojho okolia.

Kamery sú v tomto prípade podľa Elona Muska očami vozidla a neurónová sieť jeho mozgom. Časom by jeho elektromobily mali byť schopné orientovať sa na cestách plne autonómne, hoci najnovšie pripustil, že je to o niečo ťažší oriešok, ako pôvodne očakával. Jeho vývoj ale intenzívne pokračuje.

V akom stave je aktuálne tento systém snímania priestoru, sa podarilo zistiť hackerovi známemu pod prezývkou green. Exportom hĺbkových dát zistil, že elektromobily Tesla vytvárajú spomínanú priestorovú mapu v neuveriteľne nízkom rozlíšení len 160 x 120 bodov, čo predstavuje 1/8 natívneho rozlíšenia prednej kamery, ktorá je z celkovo ôsmich kamier na palube na tento účel využívaná ako jediná.

A whopping 160×120 grid (so 1/8th of the native camera resolution) but hey those are actual 3D points in space. I don't know how to make a 3D video, so just visualizing "distance" as "brighter = closer" on the scale of 5 to 62 meters (the actual limit of the output): pic.twitter.com/1XFa5JwOft

— green (@greentheonly) July 7, 2021

Ešte pred dvoma rokmi pritom Tesla na svojej tlačovej konferencii ukazovala snímanie hĺbky priestoru vo výrazne vyššom rozlíšení. Je tak celkom pravdepodobné, že automobilka narazila na aktuálny strop výpočtového výkonu svojich vozidiel a rozlíšenie musela nateraz umelo znížiť.